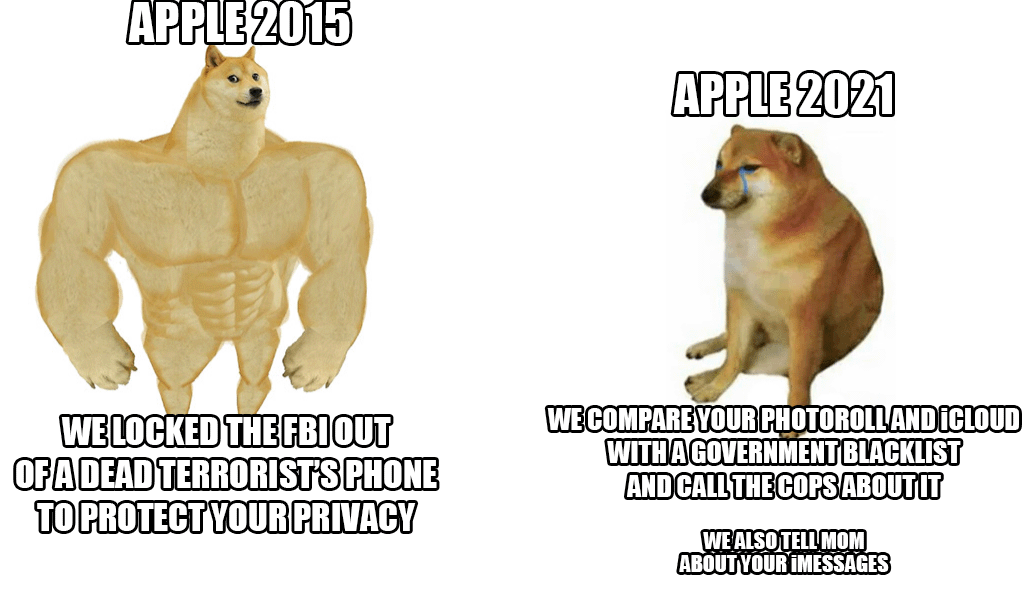

Krajem prošle sedmice, Apple je predstavio novi sistem protiv zlostavljanja djece koji će skenirati gotovo svačije iCloud fotografije. Iako ideja na prvi pogled zvuči dobro, jer djecu zaista treba zaštititi od ove akcije, giganta iz Cupertina ipak je nanijela lavina - ne samo korisnika i stručnjaka za sigurnost, već i iz redova samih zaposlenih.

Prema najnovijim informacijama ugledne agencije Reuters jedan broj zaposlenih je izrazio zabrinutost zbog ovog sistema u internoj komunikaciji na Slack-u. Navodno, trebalo bi da se plaše moguće zloupotrebe od strane vlasti i vlada, koje bi mogle da zloupotrebe ove mogućnosti, na primer, da cenzurišu ljude ili odabrane grupe. Otkrivanje sistema izazvalo je snažnu debatu, koja već ima preko 800 pojedinačnih poruka unutar pomenutog Slack-a. Ukratko, zaposleni su zabrinuti. Čak su i stručnjaci za sigurnost ranije skrenuli pažnju da bi to u pogrešnim rukama bilo zaista opasno oružje za suzbijanje aktivista, njihove spomenute cenzure i slično.

Dobra vijest (za sada) je da će novina tek početi u Sjedinjenim Državama. Trenutno nije jasno ni da li će se sistem koristiti iu zemljama Evropske unije. Međutim, uprkos svim kritikama, Apple stoji sam i brani sistem. On prije svega tvrdi da se sve provjere odvijaju unutar uređaja i kada dođe do poklapanja, tek u tom trenutku slučaj ponovo provjerava zaposlenik Applea. Samo po njegovom nahođenju biće predata nadležnim organima.

To može biti zanima vas

Ne bih volio da se prebacim s iClouda na nešto sigurno i zaista privatno, ali ako Apple insistira, svejedno ću prestati da im plaćam.

Bit će aktivan (za sada) samo u SAD-u

Nije bitno gdje će se zakonski primjenjivati. Ta tehnologija će već biti tamo i raspoređena. To je najveći rizik.